除了被黑客侵入、被偷拍外,你想过自己在VR/AR中的隐私数据还能泄露到哪一步吗?

当Riley首次进入VR迷宫游戏时,他使用了房间规模的设置,通过在客厅里走动,可以解决谜题,并探寻虚拟迷宫的不同部分。即使他的朋友们只是待在自己的客厅里,但他们也已经融入了游戏。当Riley转动头部时,他也可以与朋友们进行目光接触。他甚至可以和他们进行虚拟击掌,通过拍打虚拟替身的手掌,VR头显的控制手柄能提供震动反馈。

但Riley不知道的是,创建这款游戏的初创公司决定出售其用户的跟踪数据。他同时也不知道,20分钟的VR游戏时间记录了他200万个身体运动数据。一家保险公司是购买游戏数据的客户之一,在游戏结束的一个月后,Riley的保险公司鉴于他的健康状况拒绝与他签订新的人寿保险政策,而Riley无法理解这是为什么。

在经过几轮上诉之后,保险公司透露,Riley的VR迷宫游戏数据揭示了他的行为运动模式正处于老年痴呆症的早期阶段,受影响的还有Riley的姐姐,虽然她并未体验过VR迷宫游戏,但由于老年痴呆症往往在家族之中流行,因此也被保险公司拒绝了长期护理和终身保险。

虽然以上场景是一个假设的情况,但是在VR中使用运动来预测老年痴呆症的技术是真实存在的。目前,没有关于如何收集、使用或共享这些数据的标准或规定。

VR/AR收集的数据泄露了哪些隐私?

VR和AR的生物识别跟踪数据,包括头部、躯干、手和眼睛的微动都可以用作医疗数据。它可以诊断或预测焦虑、抑郁、精神分裂症、成瘾、ADHD、自闭症谱系障碍以及更多关于一个人的认知和身体功能。由于VR和AR应用可以检测这些与疾病相关的状态的变化,因此可以开发治疗干预措施。

但问题在于,这些医学相关的数据虽然最初可能只是为了测量用户的心理概况,但却很有可能导致Riley那样的状况出现。此外,这些数据也可能使用户在找工作时受到影响和限制。

目前来看,将VR和AR跟踪数据匿名化几乎是不可能的事,因为每个人都有独特的移动模式,没有人可以和别人保持完全一致的动作数据。利用在VR头显中收集的凝视、头部方向、手部位置、身高和其他行为等生物特征,研究人员确定用户个体的准确性要高出8到12倍。

在一项研究中,研究人员利用在VR中收集的95个时间点数据,可以识别出具有90%准确度的个体。就像邮政编码、IP地址和声纹,VR和AR的追踪数据也应该被视为潜在的“个人身份信息(PII)”,因为它可以用来区分或追踪个人的身份,无论是单独使用还是与其他个人识别信息相结合。

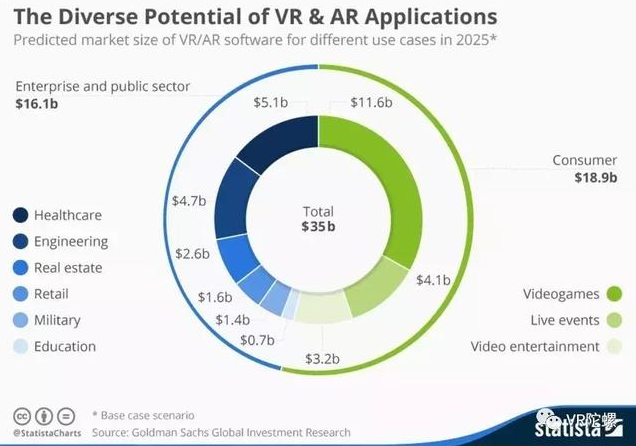

VR/AR应用的多样化潜力这是几十年来医学研究领域的专业人士一直在努力解决的问题。研究人员已经证明,通过将这些数据与其他公开数据源相结合,可以追溯到个人的健康和医疗信息,如DNA序列、医疗记录和其他可用于识别信息的健康研究数据。然而,与医疗数据不同,VR技术收集的数据目前尚未受到监管,没有任何部门或机构会监管这些VR/AR公司收集、使用和共享这些隐私数据。

用户隐私该如何保护?

2018年末,代表VR/AR硬件和软件主要参与者的VR和AR隐私政策专家以及学术界和非营利组织的专家受邀参加斯坦福大学的隐私峰会,以审查该技术的风险,并考虑潜在解决方案。大会提出的主要关注领域是损害自由、声誉,以及由于线上身份与真实身份不可分割而导致的损害。

VR和AR数据滥用可能会导致人们失去对自己身份的控制,以及他们如何选择向雇主、保险公司和其他人展示自己。特别值得关注的是,从小就开始使用VR或AR的儿童无法承担这些风险。

峰会与会者提出了一系列可用于保护用户隐私的解决方案,包括:

限制VR和AR设备收集生物识别数据,或者通过禁止收集原始数据,或者在规定的时间段后自动删除数据,以消除纵向收集数据的可能性

以简单明了的文字语言明确向用户传达数据政策(正在收集的数据及其使用方式)

不限制对用户选择加入的体验所产生的数据的访问权限,并且永远不会为用户选择默认设置

当数据策略发生变化时,应要求所有用户再次选择是否同意,不应在不告知用户的情况下对隐私政策进行多次迭代

意识到收购是隐私政策中的一个弱点:如果一家公司被另一家公司收购,用户生物识别技术和数据不应该在未经用户重新同意的情况下转移到采购公司。

一个解决方案在峰会上受到所有人的关注:采用类似于全球大学、医疗中心和公司中存在的机构审查委员会(IRB)系统。通过采用传统的IRB审查研究人员的建议,以确保当研究参与者同意成为研究的一部分时,该研究将以无偏见的方式进行,以保持其自主性,并最大限度地降低用户参与项目的风险。与一般的技术咨询委员会不同,根据定义来说IRB是独立的,参与成员具有不同的资格,并专注于道德、正义,并尊重那些作为研究数据来源的用户。

IRB模式可以在VR和AR的背景下取得成功,因为潜在的危害性相对容易被人理解,并且可能的解决方案(例如需要明确的、预期的用户对数据使用活动的同意)与现有的IRB方式一致。我们希望这种类型的评审模型可以应用在VR/AR整个行业范围内。

该模式可行的一种方式是由一个集中的专家组来审查每个公司的隐私政策,他们的作用是评估每个公司的数据收集、存储和使用政策对用户的风险。该专家组将会负责确定损害的程度和可能性,并提出建议采取的措施,以减少对用户的潜在伤害。

IRB的诞生源自于那些不道德科学研究的不幸历史,在过往的研究中使人们受到了不公平的伤害,特别是那些来自弱势群体的人们。尽管AR和VR对消费者来说是相对较新的技术,但我们认为当前的行业正朝着可能伤害到人们的方向前进着。

而在VR和AR行业内设立一个独立的机构,有助于保护用户。反过来,我们也相信这些保护措施将会吸引更多消费者使用沉浸式技术。但值得注意的是,审查委员会同样也需要进行大量的测试、迭代和改进才能使该战略可行。如果这项举措真的能够推行,VR和AR将真正成为对用户友好的技术。